Facebook AI新研究:可解釋神經(jīng)元或許會阻礙DNN的學(xué)習(xí)

人工智能模型到底「理解」了什么內(nèi)容,又是如何「理解」的呢?

回答這個(gè)問題對于改進(jìn)人工智能系統(tǒng)來說至關(guān)重要。而不幸的是,計(jì)算機(jī)科學(xué)家解釋深層神經(jīng)網(wǎng)絡(luò)(DNN)的能力遠(yuǎn)遠(yuǎn)落后于我們用它們實(shí)現(xiàn)有用結(jié)果的能力。

一種常見的理解DNN的方法集中在單個(gè)神經(jīng)元的屬性上,例如,尋找出一個(gè)單獨(dú)的神經(jīng)元,這個(gè)神經(jīng)元可以激活貓的圖像,但不能激活其他類型的圖像。

Facebook研究人員將這種對特定圖像類型的偏好稱為「類選擇性」(class selectivity)。

「類選擇性」之所以被廣泛使用,一部分原因是因?yàn)樗侵庇^的、易于理解的人類術(shù)語(也就是說,這些神經(jīng)元是網(wǎng)絡(luò)的「貓」部分)。

事實(shí)上,這些可解釋的神經(jīng)元,會自然而然地出現(xiàn)在經(jīng)過各種不同訓(xùn)練的神經(jīng)網(wǎng)絡(luò)中。

例如,經(jīng)過訓(xùn)練可以對許多不同類型的圖像進(jìn)行分類的DNN含有的某些神經(jīng)元,這些神經(jīng)元對拉布拉多尋回犬的激勵(lì)最為強(qiáng)烈,也就是說,神經(jīng)元是有選擇性的。

研究人員發(fā)現(xiàn)強(qiáng)有力的證據(jù)表明「即使神經(jīng)元在很大程度上不具有類選擇性,DNN 也能很好地發(fā)揮作用」。事實(shí)上,易于解釋的神經(jīng)元會損害 DNN 功能,甚至使網(wǎng)絡(luò)更容易受到隨機(jī)畸變輸入的影響。

Facebook 發(fā)現(xiàn)可以通過開發(fā)一種新技術(shù),直接控制 DNN 的神經(jīng)元的類選擇性。如果這些方法沒有經(jīng)過嚴(yán)格的測試和驗(yàn)證,那么過分依賴于基于直覺的方法來理解DNN可能會產(chǎn)生誤導(dǎo)性。為了完全理解人工智能系統(tǒng),我們必須努力尋找不僅是直觀的而且是經(jīng)驗(yàn)性的方法。

「類選擇性」:深度神經(jīng)網(wǎng)絡(luò)可解釋性的工具

研究人員最近開始研究是否易于解釋的神經(jīng)元對 DNN 功能實(shí)際上是重要的,但不同的研究報(bào)告的結(jié)果有時(shí)是相互矛盾的。

為了解決這個(gè)問題,我們采用了一種新的方法來操縱類的選擇性: 當(dāng)訓(xùn)練一個(gè)網(wǎng)絡(luò)來分類圖像時(shí),我們不僅指示該網(wǎng)絡(luò)提高其分類圖像的能力,我們還增加了一個(gè)動(dòng)機(jī)來減少(或增加)其神經(jīng)元的類選擇性。

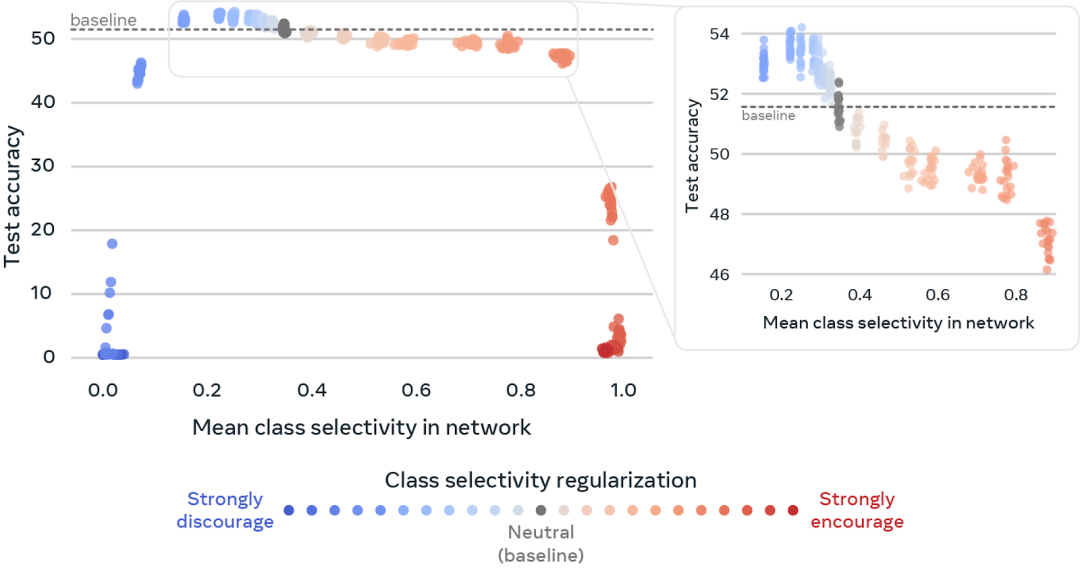

上圖展示了操縱 DNN 中神經(jīng)元的類選擇性會如何影響 DNN 正確分類圖像的能力(在 Tiny ImageNet 上訓(xùn)練的 ResNet18)。

每個(gè)點(diǎn)代表一個(gè) DNN。點(diǎn)的顏色代表了 DNN 神經(jīng)元中「類選擇性」被使用或禁止的程度。X 軸顯示 DNN 神經(jīng)元之間的平均類選擇性,Y 軸顯示 DNN 對圖像分類的準(zhǔn)確程度。

灰點(diǎn)是中性的,既不使用也不禁止類選擇性,代表了這種類型 DNN 中自然出現(xiàn)的類別選擇性水平,用它作為比較分類準(zhǔn)確性的基準(zhǔn)。

通過阻止類別選擇(藍(lán)點(diǎn)) ,可以提高測試的準(zhǔn)確性超過2% 。相比之下,鼓勵(lì)類選擇性(紅點(diǎn))對 DNN 的圖像分類能力造成迅速的負(fù)面影響。通過放大數(shù)據(jù)的一個(gè)子集,以更好地說明減少和增加類選擇性的影響。

通過在損失函數(shù)中添加一個(gè)類選擇性來做到這一點(diǎn)。研究人員用一個(gè)參數(shù)來控制類選擇性對網(wǎng)絡(luò)的重要性。改變這個(gè)參數(shù)會改變我們是使用還是阻止易于解釋的神經(jīng)元,以及改變到什么程度。

通過調(diào)節(jié)參數(shù),可以實(shí)現(xiàn)「類選擇性」跨越所有網(wǎng)絡(luò)層。實(shí)驗(yàn)結(jié)果如下:

1.當(dāng)降低DNN的類選擇性時(shí),我們發(fā)現(xiàn)它對性能幾乎沒有影響,在某些情況下甚至提高了性能。這些結(jié)果表明,盡管 DNN 在任務(wù)和模型中普遍存在,但類選擇性并不是 DNN 功能的一部分,有時(shí)甚至?xí)?DNN 功能產(chǎn)生負(fù)面影響。

2.當(dāng)提高DNN的類選擇性時(shí),我們發(fā)現(xiàn)對網(wǎng)絡(luò)性能有顯著的負(fù)面影響。第二個(gè)結(jié)果表明,類選擇性的存在并不能保證 DNN 正常工作。

走出實(shí)驗(yàn)室,生產(chǎn)環(huán)境中數(shù)據(jù)更復(fù)雜

與研究環(huán)境相比,部署在工業(yè)環(huán)境中的DNN通常需要處理更為嘈雜和更為扭曲的數(shù)據(jù)。

例如,一個(gè)研究用DNN可以從維基百科上看到非常清晰的貓的圖像,而在工業(yè)中,DNN 需要處理一個(gè)黑暗的、模糊的貓?zhí)优艿膱D像。

研究人員實(shí)驗(yàn)發(fā)現(xiàn),類選擇性的降低使DNN對模糊和噪聲等自然失真更具有魯棒性。而有趣的是,類別選擇性的降低也使 DNN 更容易受到有針對性的攻擊,在這種攻擊中,圖像被有意操縱以欺騙 DNN。

這個(gè)結(jié)果出人意料有兩個(gè)原因: 第一,因?yàn)轭愡x擇性已經(jīng)被廣泛用于理解 DNN 函數(shù); 第二,因?yàn)轭愡x擇性在大多數(shù) DNN 中自然存在。

研究結(jié)果還表明,在缺乏類選擇性的情況下,DNN自然地學(xué)習(xí)盡可能多的類選擇性,而不會對性能產(chǎn)生負(fù)面影響。

所有這些工作都是 Facebook 進(jìn)一步解釋人工智能的一部分,包括為機(jī)器學(xué)習(xí)開發(fā)人員提供開源解釋工具,以及與平臺建立伙伴關(guān)系。

最終,這項(xiàng)工作將幫助研究人員更好地理解復(fù)雜的人工智能系統(tǒng)是如何工作的,并研發(fā)出更健壯、可靠和有用的模型。

(聲明:本文僅代表作者觀點(diǎn),不代表新浪網(wǎng)立場。)