Gary Marcus公開喊話Hinton、馬斯克:深度學習就是撞墻了,我賭十萬美金

歡迎關注“新浪科技”的微信訂閱號:techsina

文/機器之心

來源:機器之心(ID:almosthuman2014)

2029 年實現 AGI ? Gary Marcus:不可能,我賭十萬美金。

“如果有人說(深度學習)撞墻了,那么他們只需列出一張清單,列出深度學習無法做到的事情。5 年后,我們就能證明深度學習做到了。”

6 月 1 日,深居簡出的 Geoffrey Hinton 老爺子做客 UC 伯克利教授 Pieter Abbeel 的播客節目,倆人進行了長達 90 分鐘的對談,從 Masked auto-encoders、AlexNet 聊到脈沖神經網絡等等。

在節目里,Hinton 明確對“深度學習撞墻了”這個觀點發起質疑。

“深度學習撞墻了”這個說法,來自知名 AI 學者 Gary Marcus 三月份的一篇文章。準確地說,他認為“純粹的端到端深度學習”差不多走到盡頭了,整個 AI 領域必須要尋找新出路。

出路在哪兒?按照 Gary Marcus 的想法,符號處理將大有前途。不過這個觀點一向沒有受到社區重視,之前 Hinton 甚至說過:“在符號處理方法上的任何投資都是一個巨大的錯誤。”

Hinton 在播客里的公開“反駁”顯然引起了 Gary Marcus 的注意。

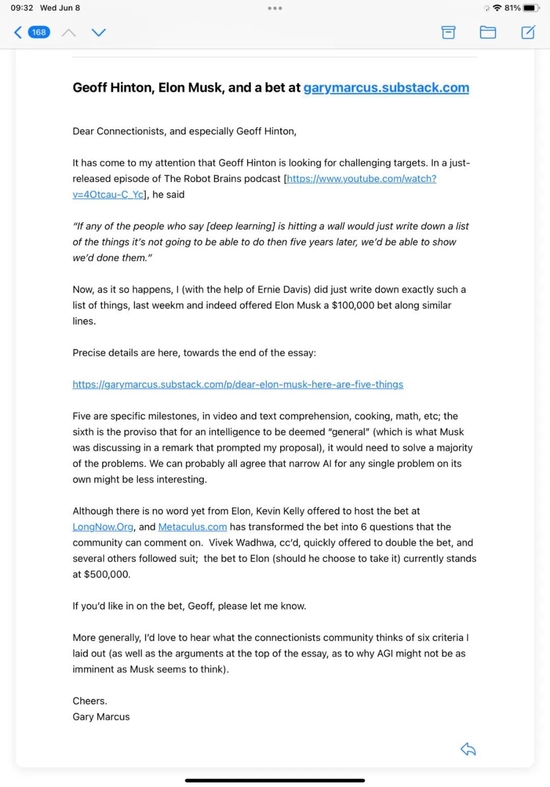

就在十幾個小時前,Gary Marcus 在推特上發出了一封給 Geoffrey Hinton 的公開信:

信里是這么說的:“我注意到,Geoffrey Hinton 正在尋找一些挑戰性的目標。在 Ernie Davis 的幫助下,我確實已經寫下了這樣一個清單,上周我還向馬斯克發出了一個 100000 美元的賭約。”

這里又有馬斯克什么事?原因還要從 5 月底的一條推特說起。

與馬斯克的十萬美金賭約

一直以來,人們所理解的 AGI 是太空漫游(HAL)和鋼鐵俠(JARVIS)等電影中描述的那種 AI。與當前為特定任務訓練的 AI 不同,AGI 更像人腦,可以學習如何完成任務。

大多數專家認為 AGI 需要幾十年才能實現,而有些人甚至認為這個目標永遠不可能實現。在對該領域專家的調查中,預估到 2099 年將有 50% 的機會實現 AGI。

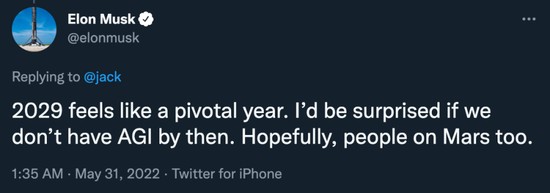

相比之下,馬斯克顯得更加樂觀,甚至在推特上公開表達:“2029 年是關鍵的一年,如果那時我們還沒有實現 AGI,我會感到驚訝。希望火星上的人們也是如此。”

表示并不認同的 Gary Marcus 很快反問:“你愿意賭多少錢?”

雖然馬斯克并沒有回復這條提問,但 Gary Marcus 繼續表示,可以在 Long Bets 組局,金額是十萬美元。

在 Gary Marcus 看來,馬斯克的相關觀點不大靠譜:“比如你在 2015 年說過,實現完全自動駕駛的汽車還需要兩年時間,從那以后,你幾乎每年都說一遍同樣的話,可現在完全自動駕駛仍未實現。”

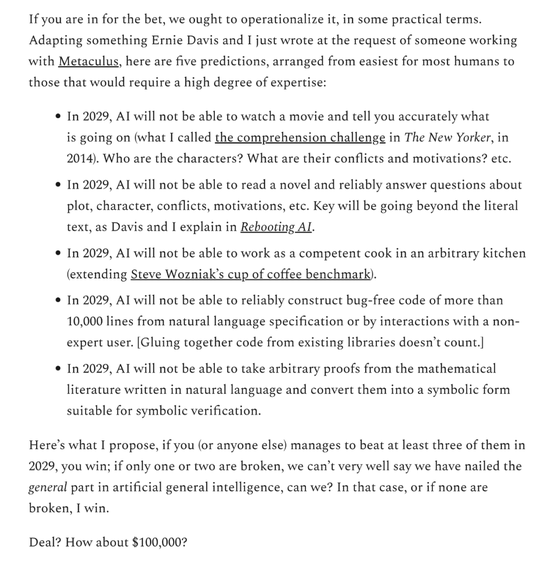

他還在博客中寫下了五個檢驗 AGI 是否實現的標準,作為打賭的內容:

2029 年,AI 無法看懂電影然后準確告訴你正在發生的事情(人物是誰、他們的沖突和動機是什么等);

2029 年,AI 無法閱讀小說并可靠地回答有關情節、人物、沖突、動機等的問題;

2029 年,AI 無法在任何廚房中擔任稱職的廚師;

2029 年,AI 無法通過自然語言規范或與非專家用戶的交互可靠地構建超過 10000 行的無錯誤代碼(將現有庫中的代碼粘合在一起不算數);

2029 年,AI 無法從以自然語言編寫的數學文獻中任意取證,并將其轉換為適合符號驗證的符號形式。

“這是我的建議,如果你(或任何其他人)在 2029 年設法完成至少三個,就算你贏了。Deal?十萬美元如何?”

在更多人的追捧下,這個賭約的金額已經上升到了 50 萬美元。不過,截至目前,馬斯克再無回復。

Gary Marcus:AGI 并不像你想象的“近在眼前”

6 月 6 日,Gary Marcus 在《科學美國人》發表文章,重申了自己的觀點:AGI 并非近在眼前。

對于普通人來說,人工智能領域似乎正在取得巨大進步。在媒體的報道中:OpenAI 的 DALL-E 2 似乎可以將任何文本轉換成圖像,GPT-3 無所不知,DeepMind 5 月發布的 Gato 系統在每一項任務上都性能良好......DeepMind 的一位高級管理人員甚至吹噓已開始尋求通用人工智能 (AGI)、AI 具有與人類一樣的智能水平......

別被騙了。機器有一天可能會和人一樣聰明,甚至可能更聰明,但遠不是現在。要創造真正理解和推理現實世界的機器,還有大量的工作要做。我們現在真正需要的是更少的吹捧姿態和更多的基礎研究。

可以肯定的是,人工智能確實在某些方面取得了進步——合成圖像看起來越來越逼真,語音識別可以在嘈雜環境中工作——但我們距離通用的人類水平 AI 還有很長的路要走,例如人工智能現在還不能理解文章和視頻的真正含義,也不能處理意外障礙和中斷。我們仍然面臨 AI 多年來一直存在的挑戰——讓人工智能變得可靠。

以 Gato 為例,給定任務:為投手投擲棒球的圖像加上標題,系統返回三個不同的答案:“一名棒球運動員在棒球場上投球”、“一名男子向棒球場上的投手投擲棒球”和“一名棒球運動員在擊球,一名接球手在一場棒球比賽”。第一個答案是正確的,而其他兩個答案似乎包含圖像中看不到的其他球員。這說明 Gato 系統并不知道圖像中的實際內容,而是了解大致相似圖像的典型內容。任何棒球迷都能看出這是剛剛投球的投手——雖然我們預計附近有接球手和擊球手,但他們顯然沒有出現在圖像中。

同樣,DALL-E 2 會混淆這兩種位置關系:“藍色立方體頂部的紅色立方體”和“紅色立方體頂部的藍色立方體”。類似地,5 月谷歌發布的 Imagen 模型無法區分“宇航員騎馬”和“馬騎宇航員”。

當 DALL-E 這樣的系統出錯時,你可能還覺得有些滑稽,但有一些 AI 系統如果出錯,就會產生非常嚴重的問題。例如,一輛自動駕駛的特斯拉最近直接向路中間拿著停車標志的工人開去,人類司機干預后才能減速。該自動駕駛系統可以單獨識別人類和停車標志,但遇到兩者的不尋常組合時就未能減速。

所以,很不幸,AI 系統仍然不可靠,并且難以迅速適應新環境。

Gato 在 DeepMind 報告的所有任務上都表現出色,但很少能像其他當代系統一樣。GPT-3 經常寫出流利的散文,但仍然難以掌握基本的算術,而且它對現實的了解太少,很容易產生“一些專家認為吃襪子有助于大腦改變狀態”之類令人匪夷所思的句子。

這背后存在的問題是,人工智能領域最大的研究團隊不再是學術機構,而是大型科技企業。與大學不同,企業沒有公平競爭的動力。他們的新論文沒有經過學術審查就通過新聞發布,引導媒體報道,并回避同行評審。我們所獲得的信息只是企業本身想讓我們知道的事情。

在軟件行業,有一個專門的詞代表這種商業策略“demoware”,指軟件的設計很適合展示,但不一定適合現實世界。

而這樣營銷的 AI 產品,要么無法順利發布,要么在現實中一塌糊涂。

深度學習提高了機器識別數據模式的能力,但它存在三大缺陷:學習的模式是膚淺的,而不是概念性的;產生的結果難以解釋;很難泛化。正如哈佛計算機科學家 Les Valiant 所指出的:“未來的核心挑戰是統一 AI 學習和推理的形式。”

目前,企業追求的是超越基準,而不是創造新的想法,他們用已有的技術勉強進行小幅改進,而不是停下來思考更基本的問題。

我們需要有更多的人詢問“如何構建可以同時學習和推理的系統”等基本問題,而不是追求華麗的產品展示。

這場關于 AGI 的爭辯遠未到達終點,也有其他研究者陸續加入。研究者 Scott Alexander 就在博客中指出,Gary Marcus 是個傳奇,過去幾年里寫的東西或多或少不完全準確,但仍然有其價值。

比如 Gary Marcus 此前曾經批判過 GPT-2 的一些問題,八個月后,GPT-3 誕生時,這些問題都得以解決。但 Gary Marcus 并沒有對 GPT-3 留情,甚至寫了一篇文章:“OpenAI 的語言生成器不知道它在說什么。”

本質上說,一個觀點目前而言是對的:“Gary Marcus 以嘲笑大型語言模型為噱頭,但之后這些模型會變得越來越好,如果這個趨勢持續下去,AGI 很快就會實現。”