打開正經(jīng)圖片,你可能會(huì)看到一張黃圖,這種造假方法能同時(shí)騙過AI和人眼

原標(biāo)題:打開正經(jīng)圖片,你可能會(huì)看到一張黃圖,這種造假方法能同時(shí)騙過AI和人眼 來源:量子位

關(guān)注前沿科技

曉查 發(fā)自 凹非寺?

量子位 報(bào)道 | 公眾號(hào) QbitAI

曉查 發(fā)自 凹非寺?

量子位 報(bào)道 | 公眾號(hào) QbitAI

你能看出下面兩張圖有什么區(qū)別嗎?

它們看起來一樣,都是廣場風(fēng)景照。只是右邊的仔細(xì)一看,會(huì)發(fā)現(xiàn)有些“奇怪的點(diǎn)陣”。

但在AI的眼里,右邊的照片卻是一只哈士奇。為什么?

問題就出在那些“奇怪的點(diǎn)陣”里,原來把點(diǎn)陣重新組合,就能看到哈士奇的縮略圖。

這種騙過AI的方法其實(shí)并不新鮮,也不復(fù)雜。AI技術(shù)還未流行的時(shí)候,已經(jīng)有網(wǎng)友在泡論壇的時(shí)候發(fā)現(xiàn)了這種技巧:

把一張正常圖片縮小后在色情圖片里,沒點(diǎn)進(jìn)帖子,縮略圖上看到的是一張無害照片。但是如果你當(dāng)眾點(diǎn)開了這個(gè)帖子,一張黃圖顯示在眼前,立刻讓你“社會(huì)性死亡”。

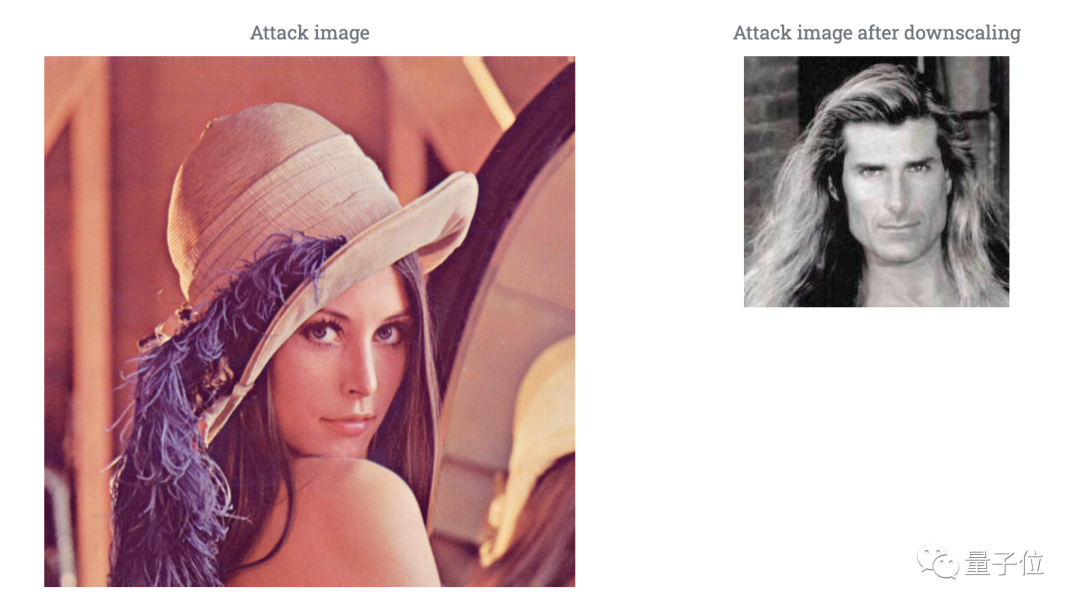

比如把著名的花花公子封面女郎Lena稍微偽裝一下,縮略圖就變成了一個(gè)長發(fā)男子。

在今年的USENIX安全研討會(huì)上,來自德國布倫瑞克大學(xué)的團(tuán)隊(duì)提出了這種攻擊AI的方法:圖片縮放攻擊(image scaling attack)。

騙過AI和人眼

圖片縮放攻擊的操作原理很簡單,把需要隱藏的圖像按比例插在新圖像的像素中,一般大圖是小圖的5到10倍。

當(dāng)圖像交給AI模型處理時(shí),出于計(jì)算成本考慮,系統(tǒng)一般會(huì)進(jìn)行預(yù)處理,也就是圖片壓縮到比較小的尺寸。而且卷積神經(jīng)網(wǎng)絡(luò)本身處理圖像時(shí),還會(huì)進(jìn)行池化(pooling)。

不僅AI,人眼也會(huì)過濾掉圖像像素中的“少數(shù)派”,被這種攻擊方法騙過。

下面,我們來看看把文章開頭的右側(cè)圖片用OpenCV的圖像壓縮預(yù)處理一下的結(jié)果:

廣場照真的變成了哈士奇。縮小的圖片和原來的圖片完全不一樣!

除了OpenCV外,該團(tuán)隊(duì)還測試了PyTorch的Pillow和TensorFlow的tf.image,幾種常見的圖像濾波器全部都中招了。

原理

縮放攻擊的根本原因是,下采樣和卷積相互作用的結(jié)果。通俗來說,就是算法沒有同等地考慮源圖像中的所有像素。

因此,攻擊者只需修改一小部分權(quán)重較高的像素,就能改變縮略圖,圖片其余大部分像素保持不變。

下面以一維情況來簡單說明一下攻擊的基本原理。

壓縮圖的像素是這樣算出來的:濾波器窗口在圖片源信號(hào)s上移動(dòng),將窗口中的每個(gè)像素值(圖中圓圈)乘以該位置窗口上的權(quán)重,得到縮略后的點(diǎn)值。

可以看到,輸出縮略圖圖中的第一個(gè)像素是s第三、第四個(gè)像素的平均結(jié)果,而第二個(gè)像素僅考慮了s第七個(gè)像素。導(dǎo)致9個(gè)像素中只有3個(gè)被用于計(jì)算縮略圖。

只有那些靠近內(nèi)核中心(三角形部分)的像素會(huì)獲得較高的權(quán)重,而其他像素對(duì)縮略圖的作用有限。

如果算法的步長超過窗口寬度,甚至有些像素還會(huì)被忽略。因此,攻擊的成功取決于高權(quán)重像素的稀疏性。

如果要進(jìn)行圖像縮放攻擊,需要做到兩點(diǎn)。首先,修改少數(shù)影響壓縮算法的像素;其次,攻擊圖像在視覺上與源圖像匹配。

如何預(yù)防

圖像縮放攻擊原理簡單,能同時(shí)騙過人眼和AI,因此布倫瑞克大學(xué)團(tuán)隊(duì)認(rèn)為這種攻擊具有一定的迷惑性。

經(jīng)過處理的圖像中,在后端,可以逃過AI對(duì)圖片的審查;在前端,可以騙過收集數(shù)據(jù)集的人,污染AI訓(xùn)練數(shù)據(jù)集。

如果有人把這些圖像摻進(jìn)自動(dòng)駕駛訓(xùn)練數(shù)據(jù)集,那么我們用訓(xùn)練出來的自動(dòng)駕駛系統(tǒng)可靠嗎?在這種情況下,汽車會(huì)不會(huì)發(fā)生意外?

當(dāng)然,這種方法并非不可預(yù)防。

既然問題出在圖像壓縮的濾波器上,那么我們只要選擇合適的濾波器就能抵御攻擊。

實(shí)驗(yàn)表明,中值濾波和隨機(jī)濾波對(duì)非自適應(yīng)攻擊提供了有效的防御。

具體到代碼上,如果你在使用OpenCV,可以通過在調(diào)用resize API時(shí)使用interpolation參數(shù)來解決,而不要使用默認(rèn)值。

TensorFlow 2.0依然容易受到攻擊,雙線性和雙三次縮放對(duì)圖像縮放攻擊具有魯棒性,可將參數(shù)antialias設(shè)置為true,但是此舉會(huì)影響網(wǎng)絡(luò)性能。

源代碼:

https://github.com/EQuiw/2019-scalingattack

論文地址:

https://www.sec.cs.tu-bs.de/pubs/2020-sec.pdf

參考鏈接:

https://embracethered.com/blog/posts/2020/husky-ai-image-rescaling-attacks/

https://scaling-attacks.net/

(聲明:本文僅代表作者觀點(diǎn),不代表新浪網(wǎng)立場。)