科技公司的尷尬戰(zhàn)爭(zhēng):算法的“好意”,險(xiǎn)些毀了一位父親的人生

題圖來(lái)源 | Lars Plougmann CC-BY-SA

題圖來(lái)源 | Lars Plougmann CC-BY-SA歡迎關(guān)注“新浪科技”的微信訂閱號(hào):techsina

不準(zhǔn)的算法,瞄中的卻有無(wú)辜的普通人。

文|杜晨 編輯|VickyXiao

來(lái)源:硅星人

家住舊金山的馬克怎么都沒(méi)想到,本來(lái)急著給自己兒子看病,給醫(yī)生發(fā)了一張照片,結(jié)果卻讓自己險(xiǎn)些身敗名裂。

事情發(fā)生在去年年初,由于當(dāng)時(shí)仍處在疫情高峰期,一些非緊急醫(yī)療機(jī)構(gòu)都關(guān)閉了服務(wù),也包括馬克家選擇的兒童診所。馬克發(fā)現(xiàn)自己兒子的私處出現(xiàn)腫脹,急忙尋求專業(yè)人士的幫助,和醫(yī)生打視頻電話。

在視頻之前,護(hù)士讓馬克發(fā)一張照片給醫(yī)生看下。馬克照做了。

然而讓他沒(méi)想到的是,這張照片可給他惹了大禍了。

圖文無(wú)關(guān) 圖片來(lái)源:Bicanski / CC0 授權(quán)

圖文無(wú)關(guān) 圖片來(lái)源:Bicanski / CC0 授權(quán)/ 愛(ài)子心切的父親,算法眼中的“戀童癖” /

在照片發(fā)出的兩天后,馬克突然接到了谷歌的一紙通知。

由于涉嫌儲(chǔ)存和傳播有害內(nèi)容,嚴(yán)重違反用戶協(xié)議和公司政策,并且涉嫌違法,他的谷歌賬號(hào)被完全關(guān)閉。

由于馬克是谷歌全家桶的忠實(shí)用戶,谷歌這一決定的后果相當(dāng)慘痛:

他不僅失去了自己的 Gmail 郵件、通訊錄、日歷,還因?yàn)槭?Google Fi 虛擬運(yùn)營(yíng)商的用戶,連手機(jī)號(hào)都被一起凍結(jié)了。

到了這里,噩夢(mèng)還遠(yuǎn)未結(jié)束。

谷歌不僅封了他的賬號(hào),還直接把這件事報(bào)到專門(mén)打擊兒童色情/性虐待內(nèi)容的監(jiān)督機(jī)構(gòu)那去了,該機(jī)構(gòu)后來(lái)又聯(lián)系了舊金山警察部門(mén)。終于在去年年底,舊金山警方從谷歌公司那里調(diào)取了關(guān)于馬克的所有資料和記錄,正式對(duì)馬克展開(kāi)了調(diào)查。

長(zhǎng)達(dá)一年的時(shí)間里,馬克面臨“戀童癖”的嚴(yán)重指控,工作生活都難以開(kāi)展,甚至幾乎“身敗名裂”……

《紐約時(shí)報(bào)》描述此事的文章提到,將馬克置于尷尬境地的,正是谷歌少為人知的兒童性虐待內(nèi)容打擊系統(tǒng)。

根據(jù)美國(guó)政府的定義,兒童性虐待內(nèi)容(Child Sexual Abuse Material,以下簡(jiǎn)稱 CSAM),包括照片、視頻等,只要其中涉及未成年人露骨色情行為的畫(huà)面,都屬于此類(lèi)內(nèi)容。更具體來(lái)說(shuō),涉及包括誘騙、勒索、展示/鼓動(dòng)/宣揚(yáng)性化 (sexualization) 未成年人、拐賣(mài)兒童性質(zhì)的內(nèi)容,都屬于谷歌明令禁止的 CSAM 范疇。

圖片來(lái)源:谷歌

圖片來(lái)源:谷歌為了防止平臺(tái)、產(chǎn)品和技術(shù)被用于傳播 CSAM,谷歌投入了大量資源,對(duì) CSAM 進(jìn)行掃描、阻止、移除和舉報(bào)——然而這次讓馬克遭殃的并不是谷歌的掃描技術(shù),而是谷歌的人工查驗(yàn)流程出了疏漏。

在各大公司,CSAM 檢索和事后舉報(bào)的流程,都包括了算法掃描和人工查驗(yàn)的雙保險(xiǎn)制度,谷歌也不免俗。然而在馬克的遭遇當(dāng)中,在算法發(fā)現(xiàn)了照片,并自動(dòng)觸發(fā)系統(tǒng)鎖死馬克的賬戶,并交由人工查驗(yàn)之后,核查員似乎并沒(méi)有考慮當(dāng)時(shí)的場(chǎng)景,沒(méi)有發(fā)現(xiàn)這張照片是發(fā)給醫(yī)療專業(yè)人士的。

事后,馬克立即進(jìn)行了申訴。然而谷歌不僅拒絕復(fù)核之前做出的決定,甚至都不讓他下載保存自己的數(shù)據(jù)。被關(guān)閉的賬號(hào),數(shù)據(jù)在兩個(gè)月后就被自動(dòng)刪除了,馬克失去了過(guò)去多年積累的很多重要信息。

事情就這樣拖了整整一年,直到去年年底警方正式啟動(dòng)了調(diào)查。

在這一年里,馬克幾近“社死”,很難跟同事和朋友完整、誠(chéng)實(shí)地解釋,自己的電話號(hào)碼、郵箱,為什么突然就憑空消失了。

直到今年前不久,當(dāng)?shù)鼐讲磐瓿闪苏{(diào)查并予以結(jié)案。

結(jié)果毫無(wú)意外:馬克無(wú)罪。

圖文無(wú)關(guān) 圖片來(lái)源:Direct Media / CC0授權(quán)

圖文無(wú)關(guān) 圖片來(lái)源:Direct Media / CC0授權(quán)對(duì)于把自己的忠實(shí)用戶推進(jìn)深淵,谷歌用法律作為擋箭牌的解釋,很合情合理,卻也綿軟無(wú)力。一位公司發(fā)言人表示,美國(guó)的兒童保護(hù)相關(guān)法律要求像谷歌這樣的公司必須對(duì)發(fā)現(xiàn)的 CSAM 事件進(jìn)行上報(bào)。

根據(jù)谷歌的透明度報(bào)告,僅在2021年度,公司就屏蔽了近120萬(wàn)個(gè)涉及 CSAM 的超鏈接,向美國(guó)相關(guān)監(jiān)督機(jī)構(gòu)“全國(guó)失蹤與受虐兒童服務(wù)中心” (NCMEC) 提交了87萬(wàn)份報(bào)告,涉及約670萬(wàn)條內(nèi)容,關(guān)閉了約27萬(wàn)個(gè)賬號(hào)。

遺憾的是,馬克不幸成為了27萬(wàn)分之一。

身處這27萬(wàn)人中間,就像那些進(jìn)了監(jiān)獄卻高喊著無(wú)辜的人一樣,那種有冤情說(shuō)不出,說(shuō)出也不被人相信的滋味,簡(jiǎn)直無(wú)法想象。

/ 好心辦壞事 /

在介紹打擊 CSAM 工作的官方頁(yè)面上,谷歌宣稱,公司組建并訓(xùn)練了專門(mén)的隊(duì)伍,使用最尖端的技術(shù)來(lái)識(shí)別 CSAM。

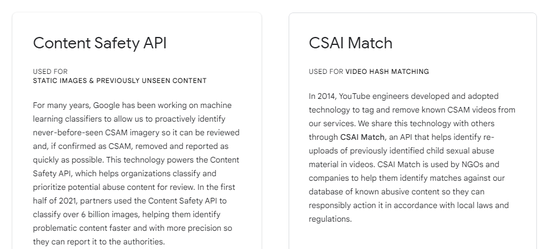

目前在美國(guó)大公司的范圍里,檢索 CSAM 有兩種技術(shù)途徑:哈希值匹配,和計(jì)算機(jī)視覺(jué)識(shí)別。

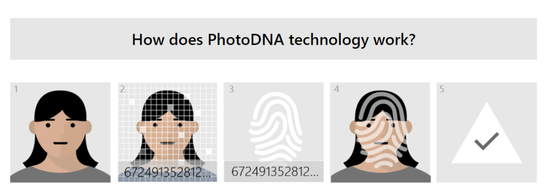

哈希值匹配比較簡(jiǎn)單,就是調(diào)取市面上第三方機(jī)構(gòu)維護(hù)的數(shù)據(jù)庫(kù)里的條目,和自己平臺(tái)上的圖片進(jìn)行哈希值匹配,從而檢測(cè)已知的 CSAM 相關(guān)內(nèi)容。這方面早年谷歌曾經(jīng)用過(guò)微軟的 PhotoDNA。這項(xiàng)技術(shù)已經(jīng)存在了10年多的時(shí)間了,不止谷歌,包括 Meta、Reddit、Twitter 等公司,以及 CSAM 領(lǐng)域的權(quán)威公共監(jiān)督機(jī)構(gòu) NCMEC,都在使用它。

圖片來(lái)源:微軟

圖片來(lái)源:微軟以及,谷歌系的 YouTube 也在使用自研的 CSAI Match 技術(shù)來(lái),實(shí)現(xiàn)流媒體視頻的哈希匹配。

當(dāng)然,每天都有新的違法圖片和視頻誕生,所以除了哈希匹配之外,谷歌還自研并部署了基于計(jì)算機(jī)視覺(jué)技術(shù)的機(jī)器學(xué)習(xí)分類(lèi)器,從而檢索“未曾見(jiàn)過(guò)”的相關(guān)內(nèi)容。

谷歌將這一技術(shù)整合到了 Content Safety API 當(dāng)中,也開(kāi)放給第三方使用。目前,包括 Meta、Reddit、Adobe、雅虎等公司,也是谷歌自研 CSAM 檢索技術(shù)的用戶和合作伙伴。

圖片來(lái)源:谷歌

圖片來(lái)源:谷歌至于本次案件,谷歌似乎是從馬克的 Google Photos 檢索到了相關(guān)內(nèi)容。

Google Photos 是谷歌推出的照片備份和云端相冊(cè)服務(wù),在自有品牌以及其它一些主流 Android 手機(jī)廠商的機(jī)型上都有預(yù)裝。值得注意的是,用戶在 Google Photos 里登錄谷歌賬號(hào)后,應(yīng)用會(huì)提示建議用戶打開(kāi)自動(dòng)上傳備份——馬克可能就是在這里吃了虧。

如果打開(kāi)了自動(dòng)上傳功能,除了在某些第三方應(yīng)用(比如 Twitter、Instagram) 下載的照片之外,包括相機(jī)照片集,以及手機(jī)上生成的其它照片,都會(huì)被 Google Photos 會(huì)自動(dòng)上傳到云端。

而根據(jù)官方網(wǎng)站和公司發(fā)言人透露的情況,谷歌不止明令限制用戶通過(guò) Google Photos 上傳和傳播相關(guān)內(nèi)容,它的 CSAM 打擊系統(tǒng),也會(huì)對(duì) Google Photos 里的照片進(jìn)行掃描和匹配。

問(wèn)題在于,根據(jù)谷歌發(fā)言人的表述,CSAM 打擊系統(tǒng)的對(duì)象僅限于用戶“主動(dòng)行為” (affirmative action) 上傳的圖片。

從務(wù)實(shí)的角度來(lái)看,馬克開(kāi)啟了 Google Photos 自動(dòng)上傳,結(jié)果因?yàn)榧敝o娃看病,拍了這張照片,自動(dòng)上傳了,忘了刪,回頭被谷歌找上麻煩——這樣也要算作主動(dòng)行為,未免有點(diǎn)牽強(qiáng)。

圖片來(lái)源:《紐約時(shí)報(bào)》

圖片來(lái)源:《紐約時(shí)報(bào)》掃描 CSAM,能夠保護(hù)兒童安全,有效地打擊戀童癖和各種變態(tài),聽(tīng)上去怎么都是一件好事對(duì)不對(duì)?

然而實(shí)際上,近年來(lái)美國(guó)大型互聯(lián)網(wǎng)和科技公司在做這件事的時(shí)候各種問(wèn)題故障和丑聞不斷——結(jié)果就是,算法自動(dòng)化打擊 CSAM 這件事,在技術(shù)道德和隱私權(quán)方面已經(jīng)引發(fā)了巨大爭(zhēng)議。

如果把谷歌這次烏龍事件形容為“人禍”的話,那么去年同一時(shí)間蘋(píng)果出的事故,可以稱得上“天災(zāi)”了。

去年8月初,蘋(píng)果突然宣布,將要在 iOS 平臺(tái)上推出一個(gè)專門(mén)掃描 CSAM 的客戶端側(cè)工具。

圖片來(lái)源:蘋(píng)果公司

圖片來(lái)源:蘋(píng)果公司蘋(píng)果突出的關(guān)鍵詞在“端側(cè)”上:和谷歌一直以來(lái)掃描云端服務(wù)器存儲(chǔ)的用戶內(nèi)容的做法不同,蘋(píng)果表示只會(huì)在用戶設(shè)備上做這件事,系統(tǒng)會(huì)下載 NCMEC 的數(shù)據(jù)庫(kù),然后完全在本地進(jìn)行哈希值匹配。

然而,蘋(píng)果所謂的“端側(cè)”、“注重隱私”等,只是表面說(shuō)辭。有專家發(fā)現(xiàn),實(shí)際上用戶發(fā)送到 iCloud 保存的照片也會(huì)成為檢測(cè)對(duì)象。還有研究者發(fā)現(xiàn)蘋(píng)果所采用的匹配算法 NeuralHash 存在設(shè)計(jì)理念缺陷。而且這一技術(shù)根本不是即將推出,而是好久以前就偷偷植入到公開(kāi)版 iOS 里了,蘋(píng)果還專門(mén)混淆了 API 命名,以便“隱姓埋名”。

結(jié)果,蘋(píng)果宣布了這件事之后沒(méi)出一個(gè)月,就有人對(duì) NeuralHash 算法實(shí)現(xiàn)了哈希碰撞和“原像攻擊”。

簡(jiǎn)單來(lái)說(shuō),哈希碰撞就是找到兩張哈希值相同的隨機(jī)照片;而原像攻擊,則是“刻意生成的碰撞”,也即先給定一張照片,然后生成另一張和其哈希值相同,但內(nèi)容不同的照片。

甚至,有人直接在廣受歡迎的 ImageNet 標(biāo)注圖像數(shù)據(jù)庫(kù)里,都能夠找到幾對(duì)天然的 NeuralHash “雙胞胎”(兩張不同的原視圖片,哈希值相同)……

這些攻擊測(cè)試的結(jié)果,從原理和邏輯上直接推翻了蘋(píng)果的 CSAM 檢索技術(shù),使其一文不值。

圖片來(lái)源:Cory Cornelius

圖片來(lái)源:Cory Cornelius早期測(cè)試的結(jié)果顯示,NeuralHash 的哈希碰撞發(fā)生率和蘋(píng)果宣稱的誤報(bào)率水平差不多,屬于可以接受的范圍。然而考慮到蘋(píng)果在全球擁有超過(guò)15億設(shè)備用戶,基數(shù)過(guò)于巨大,一旦 NeuralHash 出現(xiàn)誤報(bào),甚至哈希碰撞導(dǎo)致的事故,都會(huì)波及大量用戶。

總的來(lái)看,目前谷歌、蘋(píng)果這兩大移動(dòng)平臺(tái)級(jí)超大型公司,在掃描和打擊兒童色情這件事上,都確實(shí)努力做了一些事情,也值得鼓勵(lì)。

然而這件事的另一面,卻令人大為遺憾:

因?yàn)橐粡堧S手拍出的照片,工作和生活陷入僵局,甚至險(xiǎn)些身敗名裂,這恐怕是馬克,以及不少和他經(jīng)歷相似的人,所完全沒(méi)有預(yù)料到的。

這也是整件事的尷尬之處:在過(guò)界的科技平臺(tái)和糟糕的算法面前,好心真的可能會(huì)辦壞事。

(聲明:本文僅代表作者觀點(diǎn),不代表新浪網(wǎng)立場(chǎng)。)