蔚小理接連撞車,真不怪他們?

歡迎關注“新浪科技”的微信訂閱號:techsina

L2,難倒一眾車企。

作者 | 昊晗 編輯 | Juice

來源:車東西

L2頻繁出事故,問題到底在哪里?

上周,在寧波市區(qū)的某高速路段上,一輛小鵬P7在開啟LCC功能(單車道L2)行駛時,由于車輛系統(tǒng)沒有識別到前方靜止車輛,以80km/h的速度追尾前車,造成前車一人不幸遇難。

此前,像是蔚來、小鵬、理想、特斯拉等車企的車型也曾多次出現(xiàn)過類似事故。

本次事故發(fā)生后,有關自動駕駛(L2級)是否安全、事故如何歸責等話題再次站上輿論的風口浪尖。

這里需要強調(diào)的是,按照自動駕駛等級劃分,小鵬P7的LCC功能屬于L2級自動駕駛,主要責任肯定在于駕駛員沒有及時接管車輛。

除了駕駛員分神外,頻發(fā)的事故或許也說明,現(xiàn)階段的L2級自動駕駛系統(tǒng)本身也存在一定的問題。

總結近年來的L2事故來看,事故以追尾前方靜止車輛、障礙物為主。也就是說,目前智能汽車上即使全身上下到處都是攝像頭,各種雷達也是應有盡有,還是存在感知系統(tǒng)失靈的風險。

那么,為何會出現(xiàn)這樣的問題?有沒有什么辦法可以彌補這一短板?車東西在深入分析事故案例并與業(yè)內(nèi)人士交流后,找到了可能的答案。

01.

主責在駕駛員 但感知系統(tǒng)也要背鍋

從事故現(xiàn)場的監(jiān)控錄像來看,這輛小鵬P7在發(fā)生碰撞前并沒有明顯的加減速,幾乎是以一種勻速行駛的狀態(tài)追尾前車。

而車輛當時開啟了小鵬的LCC功能,該功能是指自適應巡航(ACC)與車道保持(LKA)同時開啟,也可以理解成在一條車道內(nèi)的L2級自動駕駛。

當該功能開啟時,車輛會根據(jù)前車車距自動控制車速并在車道內(nèi)居中行駛,而車主也可以自定義設置跟車距離的遠近。

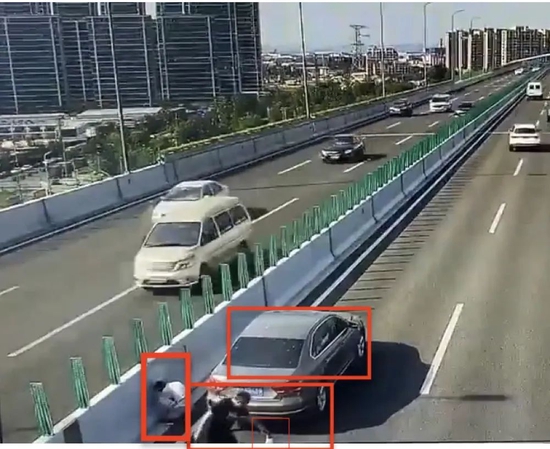

▲事故前車輛沒有任何減速跡象(最左側車道)

▲事故前車輛沒有任何減速跡象(最左側車道)所以,車輛在發(fā)生碰撞前沒有任何的減速或避讓行為,也就一定程度上證明車輛大概率是沒有感知到前方障礙或感知結果有誤。

但這只是說明車輛感知系統(tǒng)存在一定的問題,而整場事故的原因還是由于駕駛員分神沒有及時接管車輛導致,責任在駕駛員。

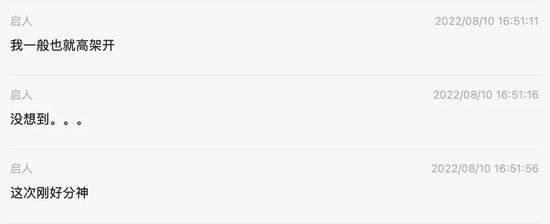

▲駕駛員分神為此次事故主要原因

▲駕駛員分神為此次事故主要原因根據(jù)車主描述,他的小鵬P7搭載Xpilot 2.5硬件,感知硬件由1個單目攝像頭、3個毫米波雷達、4個環(huán)視攝像頭、12個超聲波雷達組成,計算平臺也不是高配車型上的英偉達Xavier,而是算力只有2.5TOPS的Mobileye Eye Q4芯片。

其中,單目攝像頭、毫米波雷達主要為L2級自動駕駛提供感知,而4個環(huán)視、12個超聲波雷達則主要為泊車提供感知。

▲車主自述截圖

▲車主自述截圖根據(jù)資料顯示,Xpilot 2.5的單目攝像頭與Xpilot 3.0的中距感知攝像頭基本一致,同為2M像素,橫向FOV為52度,有效探測距離在30~70米之間。而毫米波雷達也采用了博世最先進的第五代毫米波雷達,探測距離也在200米左右。

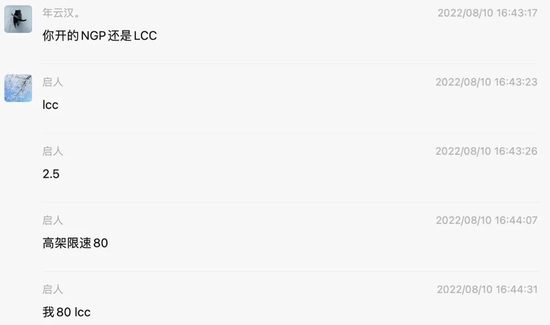

▲小鵬Xpilot的攝像頭配置

▲小鵬Xpilot的攝像頭配置從傳感器配置來看,事故發(fā)生前,無論是攝像頭還是毫米波雷達理應都能探測到前方障礙,車輛也就相應可以做出制動反應。但實際情況恰恰相反,車主反映系統(tǒng)沒識別,車輛也沒有剎車跡象。

這也就讓人產(chǎn)生疑問,明明感知硬件都有,為什么識別不到呢?

02.

異形場景視覺看不清 雷達過濾靜止物體

對于攝像頭和毫米波雷達來說,只要正常工作的情況下,絕對是可以“看到”前方道路情況的。

但此處的“看到”僅限于看得見,問題根源是視覺識別不好異形場景,毫米波雷達會過濾靜止物體,而此次事故的前車卻恰好滿足了“靜止的異形車”兩個條件。

首先,自動駕駛的視覺感知系統(tǒng)是需要大量的模型訓練才能不斷進化,什么場景訓練得多,識別成功率也就相對更高,什么場景訓練得少,識別成功率也就相對更低。

在此次小鵬L2事故中,被撞車輛是一輛老款帕薩特,其車身高度、顏色與旁邊隔離帶比較接近。并且,當時車輛正停在高速路的最左側車道,一名白衣服的乘客蹲在車輛與隔離帶之間,車輛的右后方有一個雪糕桶。

▲事故發(fā)生前1秒

▲事故發(fā)生前1秒顯然,上述場景對于視覺感知系統(tǒng)來說是陌生且復雜的,所以前方的“障礙”對于車來說,很難被系統(tǒng)識別為一臺需要做出反應的車輛。

此外,在事故發(fā)生前幾秒,前車車主又來到車尾調(diào)整雪糕筒位置,行走過程中擋住了車輛的車輪、尾燈等部件。

有業(yè)內(nèi)人士告訴車東西,車輛的視覺識別算法會依靠車輪、尾燈等車輛特征點進行識別,當車輛跟行人重疊在一起時,將會對識別算法產(chǎn)生非常大的干擾。

所以,當時小鵬P7上攝像頭的內(nèi)心獨白是:“前面是個障礙嗎?我咋從來沒見過?咋越來越模糊?到底有沒有呀?讓毫米波雷達給我確認一下”

然后,識別的壓力就來到了毫米波雷達身上。

簡單來說,毫米波雷達是通過向外發(fā)射電磁波產(chǎn)生回波進行測距、測速,其感知并不依賴大量模型訓練,因此也就不會出現(xiàn)視覺那種“糾結”的情況,看到了就是看到了,沒看到就是沒看到。

▲特斯拉老款車型上的毫米波雷達

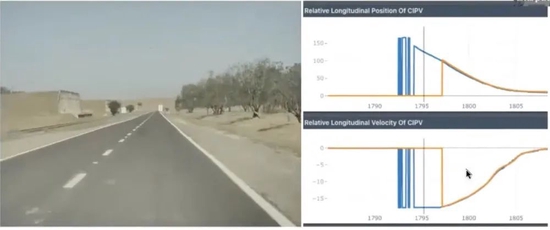

▲特斯拉老款車型上的毫米波雷達但毫米波雷達也有自己的“BUG”,其主要是依靠多普勒效應來感知移動目標。而多普勒效應的特性是,動態(tài)對動態(tài)最容易感知、動態(tài)對靜態(tài)較難感知、靜態(tài)對靜態(tài)極難感知。

所以,如果前方車輛靜止,目標信息容易和地雜波等摻雜在一起,需要一定的算法才能從中分辨出目標。而如果是一輛行駛中的汽車,基于其多普勒信息,從而比較好探測到目標。

▲毫米波雷達較難感知靜態(tài)物體

▲毫米波雷達較難感知靜態(tài)物體這里就跟當前毫米波雷達的技術現(xiàn)狀有關了——一般的毫米波雷達沒有高度信息,同時空間分辨率不足。

沒有高度信息,意味著雷達很難區(qū)分橫穿馬路的路牌和橋下的車;空間分辨率不足,意味著兩個距離很近的物體,其回波會被混在一起,很難知道有幾個目標。

如果很難區(qū)分,再把靜態(tài)目標錯誤識別為車輛,然后進行剎車會嚴重影響用戶體驗,甚至增加事故,所以一些雷達公司和自動駕駛公司會選擇將靜態(tài)物體(包括車)過濾掉,來減少誤觸發(fā)(幽靈剎車)的情況。

▲特斯拉出現(xiàn)“幽靈”剎車

▲特斯拉出現(xiàn)“幽靈”剎車而毫米波雷達的內(nèi)心獨白可能也就是“前面確實有個靜止物體!高速上怎么會有靜止的車呢?一定是個橋或者隔離帶!問題不大,告訴視覺前方一切正常。”

并且,國內(nèi)目前量產(chǎn)的L2自動駕駛系統(tǒng)有不少都將視覺作為主傳感器(權重高),雷達當作輔助傳感器(權重低)。如果視覺發(fā)現(xiàn)障礙物,不管雷達有沒有發(fā)現(xiàn),車輛都會做出反應,但反過來就不行。

比如只有雷達看到前方有障礙物,系統(tǒng)會等待視覺給出結果再做反應。如果視覺始終沒有給出結果,干脆就不反應——畢竟L2還有人類駕駛員兜底。

所以具體到這起事故,可能的原因正是因為視覺沒看到,或者沒有及時看到,毫米波雷達看到了,但被過濾掉了,才導致碰撞。

03.

激光雷達可以增強感知 前融合或為最優(yōu)解

綜上來看,異形+靜止(低速)的車或障礙也就成為現(xiàn)階段L2級自動駕駛系統(tǒng)的一大“BUG”。

這種場景出現(xiàn)的概率雖然不大,但大多發(fā)生在高速路況下,事故的傷亡率也就相對更高,所以這個“BUG”不能忽視。

對此,車企最簡單粗暴的做法就是在現(xiàn)有攝像頭和毫米波雷達基礎上,再引入激光雷達,甚至是多個高線束激光雷達,大幅提升感知能力。

相較于毫米波雷達和攝像頭,激光雷達的探測精度更高,點云密度更高。并且激光雷達也不像攝像頭那般需要對前方物體進行分類識別,只用通過反射回來的點云信息確認前方存在一個障礙物就可以,然后系統(tǒng)對此做出規(guī)避,能夠提升車輛在面對異型障礙物時的駕駛安全性。

但隨著激光雷達的加入,多傳感器融合方案又新增了一個信息來源,并不能從根本上解決上述問題,還是會存在各個感知結果之間相互“打架”的問題。

此前就有傳聞稱,小鵬P5的激光雷達在其感知系統(tǒng)中的置信度并不高,主要還是以視覺感知為主。對此,車東西也對加入激光雷達后的小鵬LCC功能進行了實際測試。

▲小鵬P5在識別到靜止車輛后提醒駕駛員接管

▲小鵬P5在識別到靜止車輛后提醒駕駛員接管當時,車東西選擇的車道前方剛好有一輛貨車,隨后同時打開了ACC和LCC,確保車輛是在輔助駕駛系統(tǒng)下前行。

出發(fā)沒多久之后,小鵬P5就識別到了前方的靜止車輛,車輛儀表盤上清晰地顯示出前方存在一輛車。

不過此時,小鵬P5并沒有明顯的降速,而是在車機頁面提醒駕駛員接管,同時安全帶也開始收緊來提醒駕駛員。在車東西沒有主動接管的情況下,車輛自動退出了LCC,但仍然保持著ACC狀態(tài)。

這也就證明,至少在現(xiàn)階段,激光雷達是用上了,但又沒完全用好。

▲小鵬P5前側激光雷達

▲小鵬P5前側激光雷達那么,怎么才能徹底解決各傳感器之間相互“打架”的問題呢?讓多傳感器之間實現(xiàn)取長補短呢?

具體來說,現(xiàn)階段大部分車輛的感知系統(tǒng)都是獨自感知、獨自處理、獨自輸出,當所有傳感器完成感知之后,再由系統(tǒng)進行所有感知結果的融合。在這個過程中,各個傳感器在不同場景下也就有不同的置信度。

所以,如果將各個傳感器的感知在像素層面就進行對齊,然后系統(tǒng)使用同一種感知算法對融合后的多維數(shù)據(jù)進行感知,進而輸出感知結果。這種方法也就不用考慮更相信哪個傳感器的數(shù)據(jù),不用再糾結。

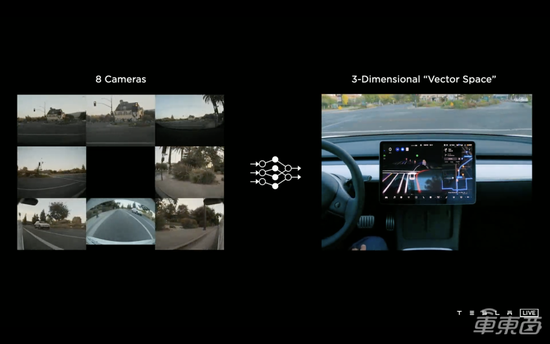

▲車身上的八個攝像頭匯集成三維的“向量空間”

▲車身上的八個攝像頭匯集成三維的“向量空間”這樣,置信度的概念也就不復存在,各傳感器之間也就能做到取長補短,融會貫通。

當然,前融合也存在像素難以對齊的難題。

特斯拉開發(fā)了“向量空間”技術,該技術可以通過8個攝像頭輸入的數(shù)據(jù)為基礎繪制3D鳥瞰視圖(BEV),形成4D的空間和時間標簽的“路網(wǎng)”以呈現(xiàn)道路等信息,幫助車輛把握駕駛環(huán)境,更精準地尋找最優(yōu)駕駛路徑。

而理想汽車在BEV感知融合算法當中,又融合了激光雷達和高精地圖的信息,進一步提升了極限情況下的感知能力。

所以,現(xiàn)階段激光雷達上車只是第一步,多傳感器之間實現(xiàn)前融合才是最優(yōu)解。

04.

結語:輔助駕駛系統(tǒng)不是自動駕駛

目前,有不少消費者都把輔助駕駛當成全自動駕駛來使用,開車睡覺、“主駕無人”等危險場景層出不窮。

此次事故,再一次為自動駕駛系統(tǒng)的使用敲響了警鐘,車企不能對消費者過度宣傳自動駕駛的能力,并需要強制要求使用者在開啟高級輔助駕駛功能時,仍需要實時關注道路情況,應對車輛無法處理的情況。

(聲明:本文僅代表作者觀點,不代表新浪網(wǎng)立場。)